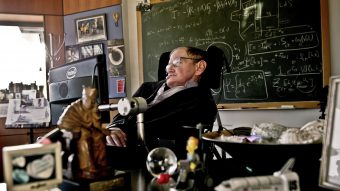

Stephen Hawking acredita que a inteligência artificial pode acabar com a humanidade

Stephen Hawking é um dos cientistas mais brilhantes vivos atualmente, mas não é dos mais otimistas no que diz respeito ao futuro da humanidade. Em seu último artigo, publicado pelo The Independent em parceria com outros pesquisadores da área, o físico traz um questionamento sobre uma potencial ameaça “interna” (quer dizer, que não vai vir de outro planeta para nos dominar e drenar nossos recursos) que nem sempre é levada muito a sério: a inteligência artificial.

O artigo foi motivado pelo filme Transcendence, que foi lançado na semana passada e trata do assunto. Mas, segundo a publicação, o longa o faz de modo a fazer parecer que a inteligência artificial é coisa do gênero de ficção científica, quando deveria estar sendo levada muito mais a sério. “O sucesso em criar inteligência artificial seria o maior evento na história da humanidade. Infelizmente, também pode ser o último, a menos que aprendamos a evitar seus riscos”, discorre.

Os frutos de inteligência artificial que temos até agora são relativamente inofensivos, como um computador que vence humanos no game show Jeopardy, assistentes pessoais no smartphone e carros que se dirigem sozinhos. Mas já são dados passos não tão seguros, como os na direção militar, com armas que selecionam e eliminam inimigos de maneira autônoma – iniciativa que inclusive já foi freada pela ONU.

Ainda assim, com o desenvolvimento da inteligência artificial, o físico defende que não há como prever como ela poderá se organizar. “Dá para imaginar essa tecnologia ficando mais inteligente que mercados financeiros, inventando mais que pesquisadores humanos, manipulando líderes e criando armas que sequer entendemos”, explica o artigo. “Enquanto o impacto da inteligência artificial a curto prazo depende de quem a controla, a longo prazo dependerá se ela poderá ser controlada”.

O alerta é bem pessimista, mas dá para entender que o ponto é de que, mais que desenvolver a inteligência artificial pelos seus motivos “do bem”, é preciso saber lidar com seus perigos. E, atualmente, isso é muito negligenciado; o físico afirma que somente quatro instituições fazem esse tipo de pesquisa hoje.

Talvez soe alarmista e até óbvio demais, mas, quando uma das maiores autoridades em ciência do mundo resolve tocar no assunto, é bom prestar atenção. E, ainda que você não trabalhe diretamente para desenvolver a tecnologia, fica a provocação no fim do artigo: “todos nós deveríamos nos perguntar o que podemos fazer agora para aumentar as chances de potencializar os benefícios e evitar os riscos”.

O artigo pode ser lido, na íntegra e em inglês, aqui.

![A bateria do celular, notebook ou tablet vicia? [Efeito memória]](https://files.tecnoblog.net/wp-content/uploads/2015/12/pilha-bateria-100x100.jpg)