Como funciona o PhotoDNA, algoritmo da Microsoft para detectar fotos de pornografia infantil

Homem que armazenava pornografia infantil no OneDrive foi preso após denúncia da Microsoft

Homem que armazenava pornografia infantil no OneDrive foi preso após denúncia da Microsoft

Não, você não está lendo a mesma notícia de dias atrás. Após o Google denunciar um homem que armazenava pornografia infantil no Gmail, a BBC News mostrou que a Microsoft também está preocupada com a pedofilia. No dia 31 de julho, a polícia da Pensilvânia, nos Estados Unidos, prendeu um sujeito com idade na casa dos 20 anos acusado de ter salvo no OneDrive uma foto de abuso sexual envolvendo uma jovem.

Assim como no caso do Google, a Microsoft usou um algoritmo para verificar automaticamente a existência da foto de pornografia infantil, sem envolver humanos no processo. O PhotoDNA, criado pela Microsoft especialmente para encontrar imagens de exploração sexual infantil, se baseia no conceito de hash, sequência de caracteres obtida a partir de um cálculo sobre o arquivo da imagem.

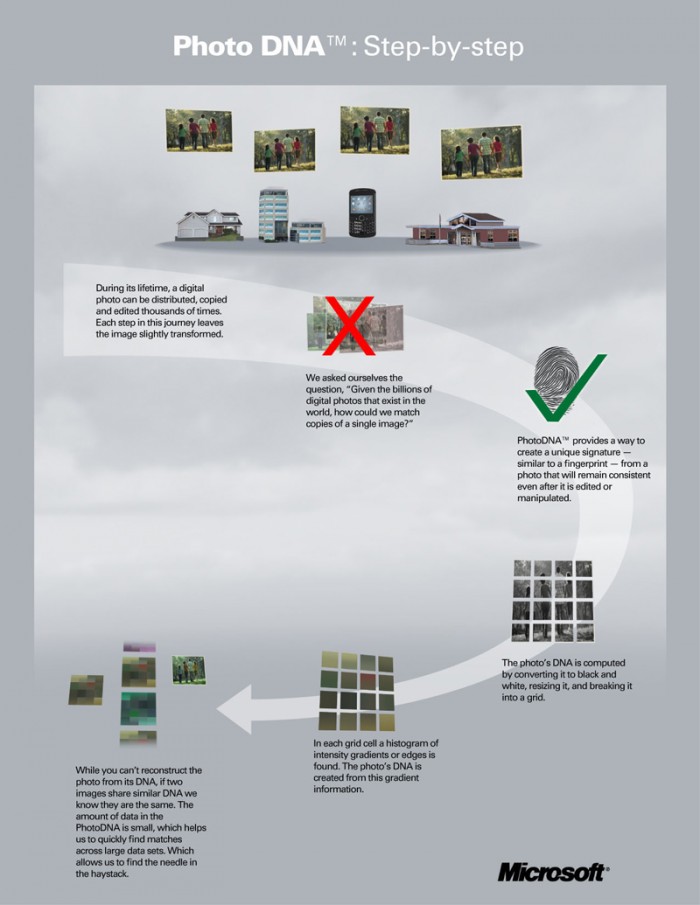

Funciona assim: a imagem é convertida para preto e branco, depois redimensionada e então dividida em várias células. Cada uma dessas células tem suas cores e gradientes analisados individualmente, gerando o DNA da foto. Caso um arquivo gere um hash já registrado previamente em um banco de dados associado a imagens de teor pedófilo, um alerta é gerado.

Apesar de ser um projeto da Microsoft Research em parceria com o Dartmouth College, o PhotoDNA também é usado por outras empresas, incluindo Google, Facebook e Twitter. A tecnologia é integrada ao Sistema de Rastreamento de Exploração Infantil (CETS, na sigla em inglês), que ajuda as autoridades a rastrearem múltiplos suspeitos. No Brasil, houve cooperação com a Polícia Federal para o desenvolvimento do sistema.

No contrato de serviços Microsoft, que você e eu certamente lemos antes de aceitá-lo, a empresa deixa claro que pode usar esse algoritmo: “Em muitos casos, a Microsoft é alertada para violações do Código de Conduta através de reclamações de clientes, mas também implantamos tecnologias automatizadas para detectar pornografia infantil ou comportamento abusivo que possa prejudicar o sistema, nossos clientes ou outras pessoas. Ao investigar essas questões, a Microsoft ou seus agentes analisarão conteúdos para resolver o problema.”

Você pode ler mais sobre o PhotoDNA no blog da Microsoft.