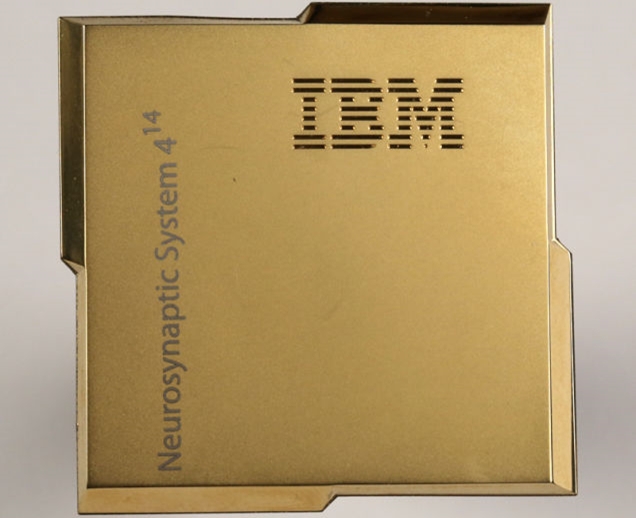

Este é o TrueNorth, processador da IBM inspirado no cérebro

Não que alguém duvidasse, mas a IBM estava falando sério quando revelou o plano de investir US$ 3 bilhões em tecnologias para suceder a Lei de Moore. Uma delas foi apresentada recentemente: o TrueNorth, um processador inspirado no cérebro que, como tal, é capaz de simular uma rede de 1 milhão de neurônios.

A novidade (ainda) não tem o mesmo poder de processamento dos chips atuais (baseados nas arquiteturas x86 e ARM, por exemplo) e, obviamente, está muito longe do que o cérebro humano é capaz de fazer – na verdade, não há nem como comparar, dentro das nossas cabeças há dezenas de bilhões de neurônios.

Mas, no atual estágio, o chip consome muito menos energia – em torno de 70 miliwatts – e se mostra bastante eficiente no processamento de informações sensoriais, como imagens, sons e movimentos.

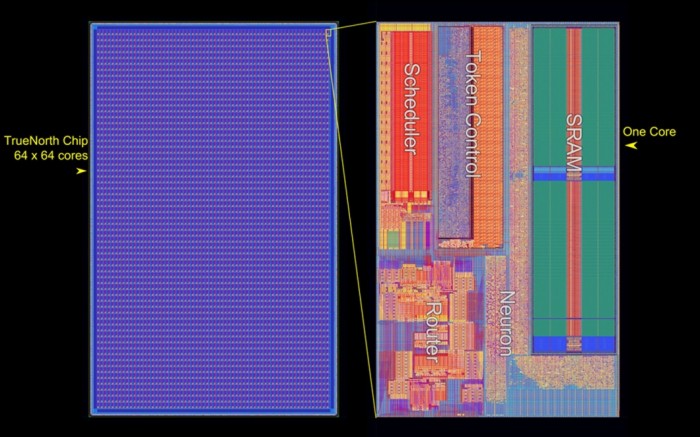

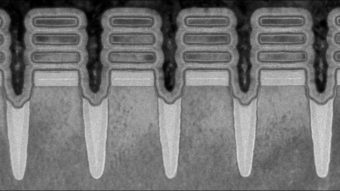

À primeira vista, o TrueNorth remete aos processadores de hoje. O protótipo atual, cuja produção ficou a cargo da Samsung, tem processo de fabricação de 28 nanômetros e é composto por 5,4 bilhões de transistores de silício.

As diferenças ficam evidentes na forma de interligação. Os transistores se conectam de maneira parecida aos neurônios, isto é, formando sinapses. O resultado desta proposta é uma rede de 4.096 “núcleos neuro-sinápticos” que, segundo a IBM, corresponde a 256 milhões de sinapses.

Muito legal! Mas qual a necessidade disso? Bom, a computação atual é baseada na Arquitetura de von Neumann, modelo que descreve processamento de dados armazenados em memória a partir de operações lineares. A arquitetura inspirada no cérebro foge deste conceito.

No TrueNorth, cada “núcleo neuro-sináptico” trabalha como se tivesse seu próprio conjunto de memória e processamento, visto que sinapses e neurônios assumem estas funções. Assim, vários grupos de núcleos podem ser direcionados a tarefas distintas. De igual forma, uma grande quantidade deles pode trabalhar em conjunto no processamento de uma atividade mais exigente.

O ganho de performance deste modelo tende a ser enorme. Segundo os pesquisadores da IBM, o principal problema da arquitetura atual é que o acesso em série obriga o processador a enviar e buscar informações na memória constantemente, criando gargalos no desempenho e exigindo mais energia.

Como são pequenos e consomem pouca eletricidade, chips “tipo cérebro” podem fazer os dispositivos vestíveis finalmente deslancharem. Os sensores poderiam atuar como pequenos processadores, abrindo um leque gigantesco de possibilidades para estes produtos.

O próprio TrueNorth, apesar de não passar de protótipo, já se mostra hábil em reconhecimento: ao analisar um vídeo, o chip conseguiu identificar pessoas, carros e até bicicletas cruzando uma via.

A tecnologia também pode ser direcionada a aplicações complexas. A IBM já estuda formas de interligar milhares de chips TrueNorth para construir um supercomputador.

Se você presumiu que vai levar algum tempo para este tipo de processador ter espaço, acertou. Além de lapidar a tecnologia, a IBM tem o desafio de fazer a proposta ser aceita: chips como TrueNorth representam uma mudança de paradigma, portanto, poderão encontrar resistência por conta de seus conceitos de programação totalmente novos.

Até mesmo desenvolvedores experientes consideram a ideia complicada, segundo Dharmendra Modha, cientista-chefe da IBM. Mas a vida deles não deve ficar muito difícil: a equipe do projeto já trabalha para disponibilizar a tecnologia com uma biblioteca de códigos pré-prontos bastante generosa.

Com informações: MIT Technology Review