O Facebook possui um recurso chamado Trending, que lista os assuntos mais populares na rede social — semelhante aos Trending Topics do Twitter, mas restrito a notícias. Ele foi alvo de polêmicas após a publicação de uma reportagem com um ex-curador de notícias do Facebook alegando que, por sofrer interferência humana, o recurso estava deliberadamente ocultando assuntos conservadores e destacando notícias que não eram tão populares assim.

Na sexta-feira (26), a Quartz noticiou que o Facebook demitiu entre 15 e 18 funcionários terceirizados que eram responsáveis pelo Trending. O recurso passou a ser controlado por algoritmos e pela equipe de engenharia do próprio Facebook. O primeiro resultado negativo veio em menos de 72 horas: a notícia mais destacada pelo algoritmo do Trending era… falsa.

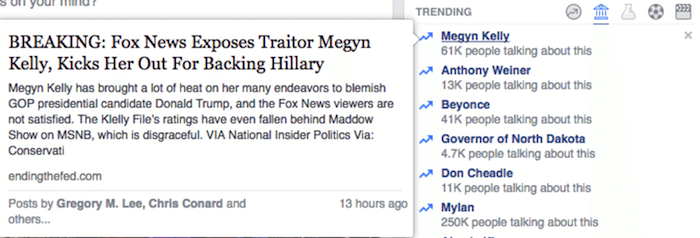

A história mais popular no Trending, publicada pelo Ending The Fed, informava que Megyn Kelly, âncora da Fox News, estava sendo punida pela emissora por apoiar a democrata Hillary Clinton; o apresentador Bill O’Reilly, do lado dos republicanos, estaria por trás da força contra Kelly. Para quem não conhece os veículos americanos, um equivalente disso seria a Veja demitir um jornalista a favor de Dilma Rousseff ou a CartaCapital mandar embora um simpatizante de Aécio Neves.

O algoritmo do Facebook não apenas colocou a notícia falsa no Trending, como a destacou no topo da lista, segundo o Washington Post. Para ordenar os assuntos mais relevantes, o robô leva em conta fatores como as páginas que os usuários curtem, a localização, os assuntos com os quais você mais interage e, claro, os assuntos mais comentados no Facebook.

Até um tempo atrás, o Facebook utilizava humanos para descrever e selecionar os tópicos do Trending, mas desistiu da ideia em resposta às críticas. Ainda existem pessoas envolvidas para filtrar os assuntos mais comentados, para assegurar que os tópicos sejam realmente notícias — evitando que uma tag #almoço entre no Trending, por exemplo. Mas, pelo visto, o algoritmo de checagem de fatos ainda não está pronto.

E não é como se a notícia utilizasse uma série de técnicas avançadas para enganar o robô do Facebook: estamos falando de um artigo com três parágrafos que nada mais era do que um plágio de uma matéria de outro site conservador, com “URGENTE” no título e sem citar fontes confiáveis — tem tanta coisa errada que um robô bem que poderia barrar a “notícia”. Em outras palavras, o Facebook ainda não sabe diferenciar a Folha de S.Paulo do Sensacionalista como fonte de informação.

A discussão sobre humanos e robôs sempre vai existir, mas parece que o Facebook virou a chave antes da hora.