A inteligência artificial é mais antiga do que você imagina

"Será que um escravo, em posse de informações inatas, poderia aprender matemática?", pensavam os filósofos

"Será que um escravo, em posse de informações inatas, poderia aprender matemática?", pensavam os filósofos

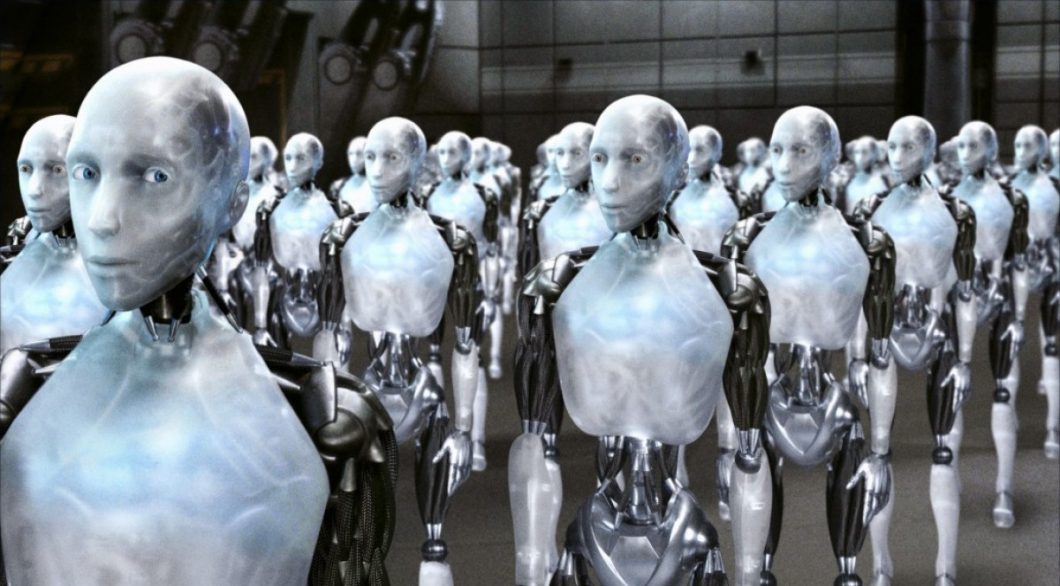

Não é de hoje que abordamos ferramentas de inteligência artificial no Tecnoblog. Vemos o Google aproveitando a tecnologia para vencer campeões mundiais de jogos de tabuleiro complexos e até combater o Aedes aegypti. A Microsoft já sinalizou vários investimentos na área, seja com “capacidade humana” ou nos aplicativos da Microsoft Research.

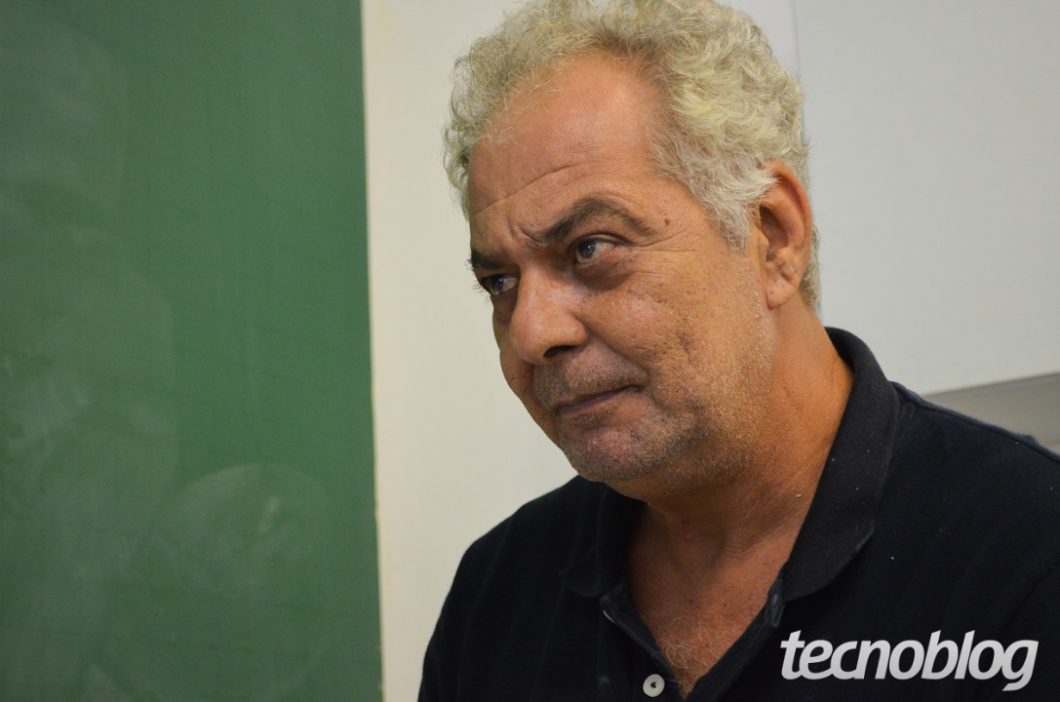

O que pouca gente sabe é que ela é uma das novidades mais… antigas, sendo idealizada em tempos até antes de Cristo. A inteligência artificial, ainda que muito mais palpável nos dias de hoje, vem até dos filósofos gregos e teve um grande avanço também no século XX. Para falar sobre o assunto, entrevistamos João Fernando Marar, professor doutor de Inteligência Artificial na Universidade Estadual Paulista (Unesp).

Para entender o que exatamente é esse termo, precisamos recorrer à origem da inteligência artificial. Ela é uma área da ciência da computação na qual os pesquisadores buscavam realidades diferentes de um modelo simplesmente programático. Não para resolver problemas simples, como adição de dois números, mas para criar uma espécie de pensamento na computação.

A área é dividida em duas partes: inteligência artificial simbólica, que é ligada à psicologia; e a de conexionismo, ou redes neurais artificiais, que vem da neurofisiologia. Essa última, para referência, foi a que o Google mencionou quando explicou como funciona o AlphaGo, robô de IA da DeepMind treinado para jogar Go.

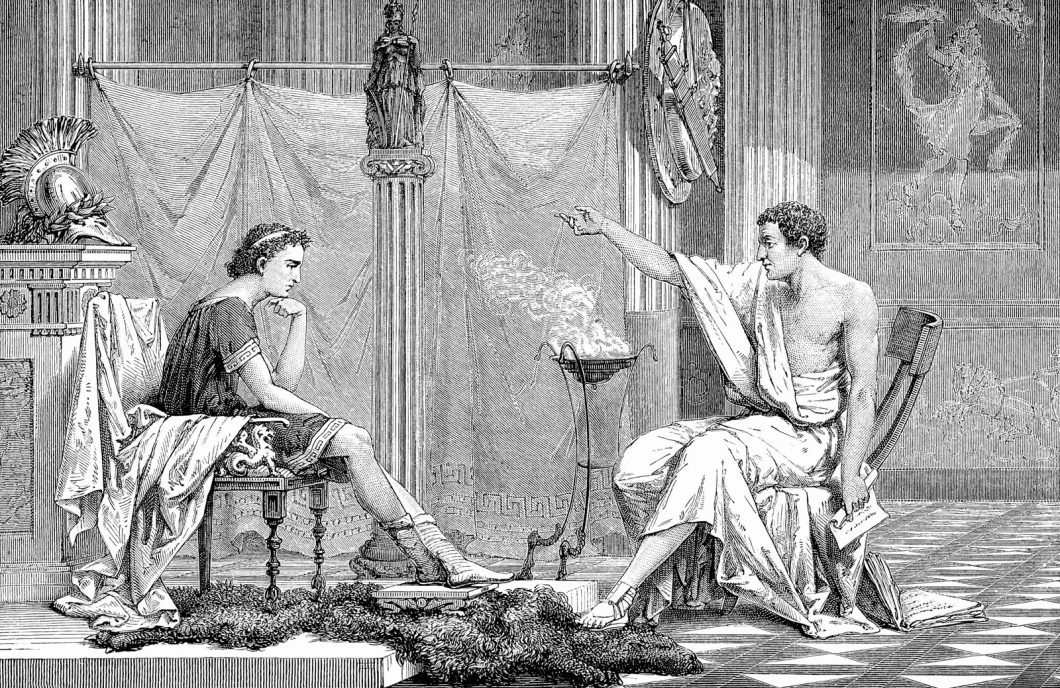

Segundo Fernando, a ciência da computação é uma área de estudo recente, mas não a inteligência artificial. “Ela vem lá dos filósofos gregos, do Platão, do Aristóteles. É muito interessante observar esses estudiosos do passado. Eles vão remontando e construindo o que nós entendemos hoje como um modelo científico”, afirma. “Aí você pensa ‘pô, mas um cara lá em 300 a.C. já pensava à frente do nosso tempo?’. Sem dúvida”, diz.

Não que já existissem sistemas que faziam coisas por si próprios, mas a ideia de uma inteligência não humana que pensasse por si própria já era idealizada, segundo o professor. Ele diz que Aristóteles, professor de Alexandre, o Grande, rei da Macedônia (na Grécia Antiga), pensava em como livrar o escravo dos seus afazeres.

“O escravo era tratado como um nada no aspecto social. Ele imaginava o seguinte: será que um objeto como uma vassoura, ou seja, um elemento que faz a limpeza, pode ter vontade própria e estabelecer o sistema de arrumação? Dessa forma, não precisaríamos mais da mão de obra escrava”, explica o professor. “Esses caras viam que não era legal ter esse domínio e sacrifício de outro ser humano. Ele inventou a robótica em 300 a.C!”, completa.

“Ele inventou a robótica em 300 a.C.”

Ele explica que os filósofos se perguntavam coisas como: “será que um escravo, em posse de informações inatas (que já vêm com a natureza do homem), poderia aprender matemática?”. É claro que sim. O revolucionário está na linha de pensamento, pois eles já idealizavam a ciência cognitiva, que trata da aprendizagem humana.

A década de 50 pode ser considerada a época dos anos dourados da inteligência artificial. Havia uma corrente psicológica chamada de “behavioristas”, que tratavam a ciência somente como ato do comportamento humano: sua mão gira segurando uma maçaneta porque você quer abrir a porta, por exemplo. Segundo o doutor, essa não é uma boa explicação. “Eu tenho que ter processamento de informação, que é o que a ciência cognitiva faz”, conta.

“Não é só uma caixa de entrada, um input e um output. Eu quero saber o que tem aqui dentro [da caixa]. É o que a inteligência artificial estuda, saber o que tem dentro dessa grande caixa. A inteligência artificial se ramifica em muitas áreas, de games à filosofia. No fundo, podemos imaginar essa ciência como uma grande capilaridade, que pode ser aplicada basicamente em tudo”, explica.

O principal, então, é entender que a inteligência artificial é uma só, mas sua capilaridade é gigantesca. Fernando trabalha nessa área há 40 anos, passando desde música e computação (na década de 90!) até uma descrição homodinâmica do funcionamento do coração junto com o pulmão, em 1983 (!). Segundo ele, esse conceito de inteligência artificial vem sendo muito bem elaborado há vários anos.

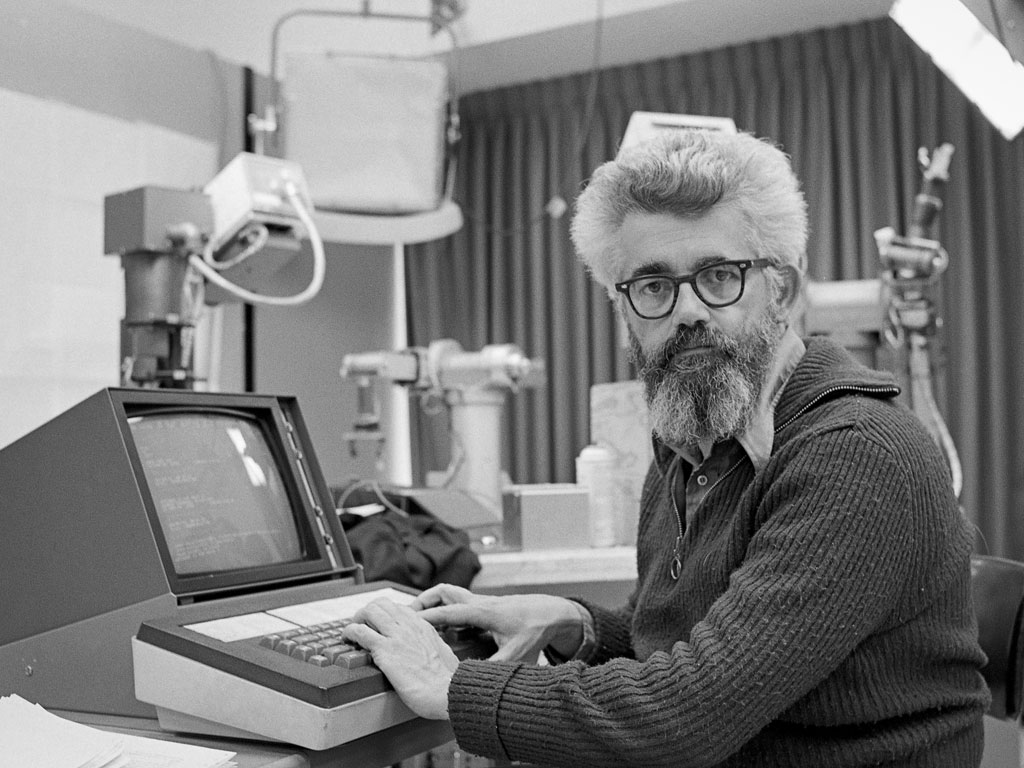

O que conhecemos hoje como inteligência artificial foi detalhado em um congresso pelo professor John McCarthy, da Universidade Stanford. Ele começou a usar o termo na conferência que fez na Faculdade de Dartmouth, em New Hampshire.

Na época, já existiam várias teorias de complexidade, simulação de linguagem, redes neurais e máquinas de aprendizagem. Ele resolveu dar o nome de inteligência artificial para esses sistemas de imaginação humana que usam a ciência da computação. Vários engenheiros, matemáticos, psicólogos e neurocientistas participaram.

A capacidade e a funcionalidade eletrônica dobravam a cada 18 meses, um crescimento quase exponencial que praticamente não parava de subir. Os participantes do congresso saíram de lá crentes que, um dia, os computadores conseguiriam ser tão inteligente quanto os humanos. Bom, ainda não aconteceu.

Mesmo assim, McCarthy conseguiu grandes avanços em seu laboratório, um dos primeiros dedicados ao desenvolvimento da inteligência artificial. Ele ganhou o prêmio Turing em 1971, dado a cientistas de computação que fizeram grandes e duradoras contribuições para a área. Fernando ressalta que esse prêmio é basicamente o Nobel da ciência da computação.

O nome vem do matemático Alan Turing, retratado no filme Jogo da Imitação. Turing também é um dos percursores da área de inteligência artificial, segundo Fernando, pois o matemático trabalhava com complexidade. Turing foi responsável por acelerar o processo de quebra do código da máquina Enigma, para entender como os alemães se comunicavam durante a Segunda Guerra Mundial.

Outro trabalho muito interessante, que também veio dele, foi o teste de Turing. Você fica de frente à um teletipo e não sabe o que conversa com você, se é um homem ou uma máquina. Se ao final da conversa você não conseguir saber identificar se é homem ou é máquina, o robô passou no teste de Turing.

Em 2014, um grupo de pesquisadores russos criou o Eugene Goostman, um robô que representa um garoto de 13 anos que mal fala inglês. Ele enganou os juízes e acabou ganhando Prêmio Loebner, que é dado para quem passa no teste de Turing.

Mas o professor se demonstrou cético em relação aos avanços dos pesquisadores russos. “Em vez deles fazerem um teste de Turing de alto nível, eles criaram o teste em baixo nível. É um garoto da Ucrânia que fala mal em inglês e o teste está sendo feito em inglês. Quando ele enrosca no processo, ele diz que é só uma criança de 13 anos e não pode responder muito bem”, explica.

Em outras palavras, é fácil enganar os juízes quando você reduz o parâmetro do que o robô pode fazer. “O bacana é colocar isso ao máximo”, diz Fernando. “Não dá pra reduzir a complexidade do problema. Eu vou enganar as pessoas ali. Vai passar no teste de Turing, com uma limitação. Mas a limitação é dos russos, e não da inteligência. O que a gente quer é muito acima”, completa.

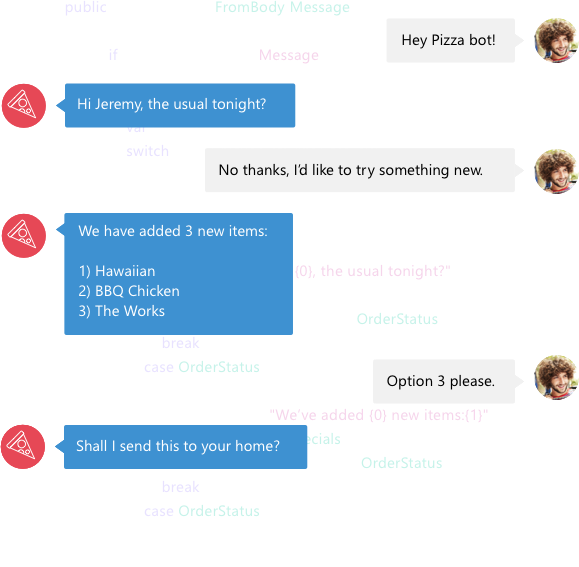

O teste de Turing tem usos até hoje. Segundo o doutor, ele deve ter servido de inspiração para a Microsoft fazer o Bot Framework, por exemplo. “Tudo recai no núcleo central, o teste de Turing. Como ele faz para alcançar isso, ele poderia usar tecnologias baseadas em sistemas psicológicos, ou redes neurais artificiais. As redes neurais artificiais são máquinas de reconhecimento, que verificam se aquilo passa pelo que a máquina aprendeu”, diz.

Estima-se que somente daqui a 20 anos uma máquina vai conseguir enganar o homem. Quando perguntado se o Bot Framework da Microsoft poderia passar no teste de Turing, ele demonstra descrença. “Não necessariamente. Ainda mais aprendendo esse jeito, perguntando para um humano quando ele não souber”, esclarece.

Fernando ainda vangloria as conquistas do matemático. “O Turing foi tão maravilhoso que ele criou alguns games que revolucionaram o mundo. A máquina de Turing que ele criou com 24 anos diz que, se um processo passa por ela, ele passará por qualquer computador que exista ou existirá”, afirma.

Sempre vemos avanços interessantes na inteligência artificial, mas o especialista vê tudo isso mais como propaganda. “Isso que os caras estão fazendo são de tecnologias que o homem conhece e já desenvolveu desde 1943. O teste de Turing é de 1950. Olhando para o século XX, a metade do século para trás teve os melhores cientistas que o universo conhecido sabe da existência. Daqui pra frente, não podemos falar nada”, garante.

Já que todo esse trabalho está em desenvolvimento há tanto tempo, perguntei a ele sobre os dilemas éticos que os computadores podem enfrentar. Já falamos sobre isso com as questões que um professor da Stanford está fazendo. O assunto é tão importante que foi tema do Tecnocast 033, intitulado Programados para matar.

Imagine que há um acidente que o carro não pode evitar, como um grupo de pedestres (incluindo uma mãe com um carrinho de bebê) que atravessou no sinal vermelho em uma pista de velocidade relativamente alta. O carro não consegue frear a tempo, então o que ele deve fazer? Atingir o menor objeto, que pode ser um carrinho de bebê ou de supermercado? Fazer uma curva brusca e arriscar a vida do motorista? A vida de quem deve ser priorizada: do motorista ou dos pedestres?

Esses dilemas com certeza já passaram na cabeça dos motoristas, que tomaram a decisão “no calor do momento”. Caso aconteça alguma tragédia, é possível até que o motorista não seja condenado porque talvez ele não tenha tido tempo o suficiente para pensar na decisão mais adequada. Com os carros autônomos, a desculpa não funciona.

Perguntei a Fernando como proceder nesses casos. Ele comparou o caso à falta de leitos na UTI. Os pacientes só vão à UTI se estiverem em estado gravíssimo; e se não houver leitos a pessoa praticamente teve a morte declarada. “Eu não tenho um caso pior para desligar alguém da UTI e colocar outro. É a mesma proporção. Eu tenho que diminuir os casos de UTI para que sempre sobrem leitos, para o gargalo nunca quebrar”, explica.

“Inteligência artificial também pode ter patologias”

Ele diz que temos que definir o que é razão no carro. “Máquinas suficientemente capazes de proceder com a razão. Se eu chego nesse dilema, de matar um ou outro, não estamos trabalhando com o lado emocional”, esclarece. “Se a gente admite que o ser humano pode esquecer e ter patologias, como o Alzheimer, vamos ter que admitir que inteligências também têm esse tipo de patologia”.

O professor ainda menciona os nanotubos de carbono, estruturas que chegam próximas da nossa própria biologia e podem ser o futuro dos núcleos dos computadores. Ele critica o medo de que uma máquina pode superar os humanos e diz que a humanidade não necessariamente precisa ser uma referência para a inteligência artificial.

“Outros seres que não possuem neurônios, como amebas, bactérias, também podem ter inteligência artificial. Eu trabalho com um modelo que é a linguagem de bactérias. Bactérias conversam umas com as outras, pelo quorum sensing. Mudando essa visão de paradigma, nós temos outras interpretações para o modelo de cura humana”, explica.

Fernando também compara o modelo de neurônios com os líquens, uma associação entre um fungo e uma alga ou cianobactéria. “São seres inteligentes que vão se conectando uns aos outros e formam uma inteligência coletiva, eles são inteligentes como um grupo. Como um neurônio, um sozinho não é inteligente, mas 100 bilhões são”, diz.

Em 2014, Stephen Hawking afirmou que a inteligência artificial pode “acabar com a humanidade”. O físico disse que, conforme o sistema vai ficando mais inteligente, podemos entrar em perigo.

O professor não tem essa preocupação. Ele comparou essa questão com a AIDS. “Você acha que o vírus da AIDS entra no seu sistema imunológico e já te mata? Não, porque se você morrer ele morre junto. Pensa comigo: os modelos também são inteligentes. Se o vírus vai sobreviver nesse novo ambiente, e ele só sobrevive se você também tiver vivo, só um estúpido mataria o seu hospedeiro”, questiona.

Ele não vê pertinência nessas questões de que a inteligência artificial pode colocar a raça humana em risco. “A gente tem que abrir mais a mente. Se eu pensar apenas pelo lado negativo, eu só construo coisas negativas”, defende. Fernando prefere pensar que dá para melhorar inúmeros problemas da humanidade com a inteligência artificial, como suas contribuições na medicina.

“A gente ainda pensa as evoluções da ciência e da tecnologia como vilãs dentro da sociedade, algo violento, porque a gente só consegue pensar em violência. Quando a gente é treinado para pensar em equilíbrio, felicidade, leveza, vamos construir os mesmos paradigmas pensando em coisas boas”, explica.