Para evitar confusões, China exige que deepfakes tenham marca d’água

Conteúdos gerados por inteligência artificial (IA) precisam de identificação, como marcas d’água, na China; regulamento entrará em vigor em 2023

Conteúdos gerados por inteligência artificial (IA) precisam de identificação, como marcas d’água, na China; regulamento entrará em vigor em 2023

Deepfakes podem ser divertidos, mas também causam danos. Esta preocupação alcançou o governo da China, que passou a solicitar identificações, como marcas d’água, em conteúdos feitos com inteligência artificial (IA). A medida visa “salvaguardar a segurança nacional e os interesses públicos sociais”.

A decisão parte da Administração Chinesa do Ciberespaço (CAC, em inglês), órgão responsável por supervisionar a internet no país.

Em uma publicação neste domingo (11), o governo revelou o “Regulamento sobre a Administração de Síntese Profunda de Serviços de Informação da Internet”.

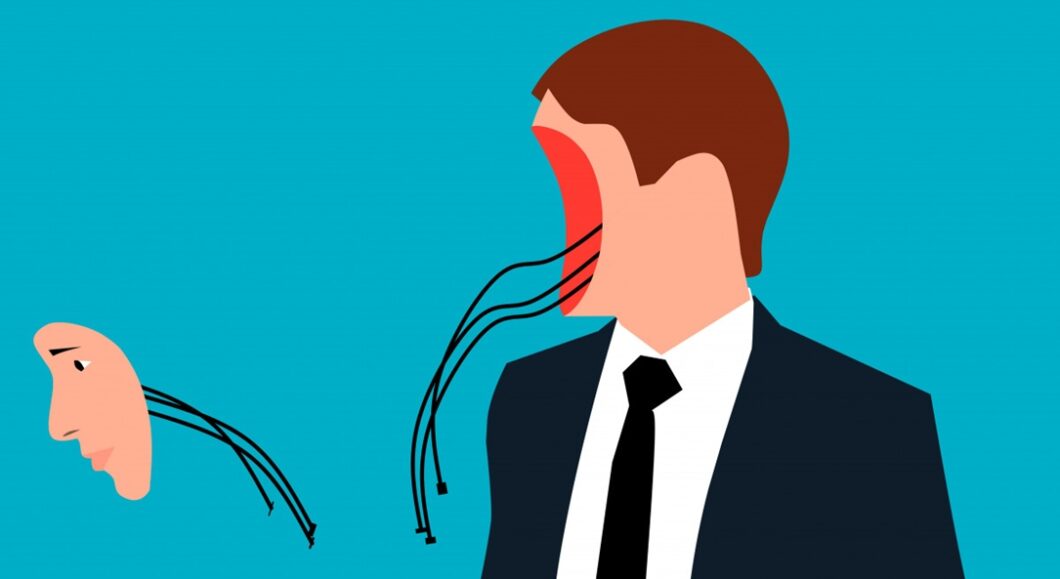

Na carta, as autoridades reconheceram que os conteúdos gerados por IA, como imagens, textos, vídeos e voz, incluindo deepfakes, são proveitosos. Mas a tecnologia também é utilizada por pessoas mal-intencionadas.

“Ao atender às necessidades do usuário e melhorar a experiência do usuário, a tecnologia também foi usada por algumas pessoas sem escrúpulos para produzir, copiar, publicar e disseminar informações ilegais e prejudiciais, caluniar e menosprezar a reputação e a honra de outras pessoas e falsificar a identidade de outras pessoas”, listaram.

Para o órgão, esta atitude “afeta a ordem de comunicação e a ordem social, prejudica os direitos e interesses legítimos do povo e põe em perigo a segurança nacional e a estabilidade social”.

E é aí que entra a novidade.

O regulamento, de acordo com o comunicado, ajuda a prevenir e resolver “riscos de segurança”.

Além disso, a iniciativa pretende “promover o desenvolvimento saudável de serviços sintéticos aprofundados e melhorar o nível de capacidade de supervisão”. Por isso, os responsáveis pelos deepfakes devem adicionar sinais, como marcas d’água, para evitar confusão pública ou identificação incorreta.

Segundo o documento, a exigência é destinada a “serviços que fornecem funções como diálogo inteligente, voz humana sintetizada, geração de rosto humano e cenas realistas imersivas que geram ou alteram significativamente o conteúdo da informação”.

Também não será permitido a edição dos conteúdos para remover a identificação.

As medidas vão entrar em vigor em 10 de janeiro de 2023.

Sem dúvidas, esta é uma medida importante e evita algumas dores de cabeça. Afinal, por mais que deepfakes sejam divertidos, a tecnologia pode ser utilizada para desinformar e até mesmo adulterar registros para incriminar alguém, por exemplo.

Claro, as ameaças não se aplicam apenas a esse tipo de ameaça. Até porque, existe o risco de edições para vídeos de porn revenge, além de outras situações constrangedoras.

Independente do motivo, o ponto é: por mais que não seja simples criar deepfakes bem-feitos, estas edições podem atingir expectadores desavisados.

No entanto, estamos falando de situações que, em vários momentos, beiram a ilegalidade. Portanto, ainda que a China crie a regulação, o efeito prático pode ser pequeno ao considerar este fator. Por outro lado, o governo chinês tem mais um aparato legal para agir nessas situações:

“Quando forem encontrados grandes riscos de segurança da informação, os departamentos de cibersegurança e informatização e os departamentos competentes relevantes podem, de acordo com suas responsabilidades, exigir que os provedores de serviços tomem medidas como suspensão de atualizações de informações, registro de contas de usuários ou outros serviços”, informaram. “Esclarecer a responsabilidade legal pela violação dos regulamentos.”

Com informações: Ars Technica e The Register