As tecnologias que dão “voz” a pessoas paralisadas

Muitas pessoas com lesões neurológicas graves não conseguem falar ou gesticular. Mas a ciência está até "lendo mentes" para não deixá-las incomunicáveis.

Muitas pessoas com lesões neurológicas graves não conseguem falar ou gesticular. Mas a ciência está até "lendo mentes" para não deixá-las incomunicáveis.

A ciência descobrirá formas de tratar lesões no cérebro que, hoje, são consideradas irreversíveis. Bom, é o que todo mundo espera. Enquanto esse dia não chega, médicos, engenheiros, cientistas da computação e especialistas de várias outras áreas se unem para criar tecnologias que possam pelo menos contornar parte das limitações causadas por essas lesões. Exemplos desses esforços vêm das pesquisas que tentam “dar voz” a pessoas que não conseguem falar, tampouco se movimentar.

O cérebro humano é um órgão fascinante, mas deveras sensível. Uma simples batida na cabeça, mesmo que de baixa intensidade, é suficiente para causar uma concussão que deixará a pessoa com tonturas, dores ou distúrbios visuais por alguns dias.

Geralmente, o cérebro consegue se recuperar rapidamente de concussões. Mas uma batida mais forte na cabeça pode deixar consequências para sempre. O mesmo vale para lesões ou processos degenerativos oriundos de problemas como esclerose lateral amiotrófica (ELA), acidente vascular cerebral (AVC) ou doença de Alzheimer.

Dependendo da gravidade e da evolução do problema, a pessoa perde, repentina ou progressivamente, a capacidade de se movimentar e falar. Ela está lá, consciente e, na medida do possível, atenta ao que acontece ao seu redor. Mas ela não pode reagir ou se expressar. Como Stephen Hawking disse certa vez, “apesar de não me movimentar e falar por meio de um computador, em minha mente eu sou livre”. É o que se conhece como síndrome do encarceramento.

Obviamente, trata-se uma situação dramática ao extremo. De fato, é como se a pessoa estivesse presa ao próprio corpo. Quem já teve paralisia do sono (quando você acorda, mas não consegue se mexer, como se o corpo ainda estivesse dormindo) talvez consiga ter uma noção mínima, bem mínima, de como é passar por isso.

A pessoa perde completamente a autonomia na ausência de mobilidade, obviamente. Mas não poder se comunicar é realmente a limitação mais impactante, pois a base do reconhecimento como indivíduo está na capacidade de se expressar e interagir.

Esse aspecto é tão significativo que, nos casos em que a evolução do problema é progressiva, até o movimento mais discreto pode ser aproveitado para comunicação. O exemplo mais emblemático vem de Stephen Hawking. O cientista foi diagnosticado com ELA aos 21 anos de idade. Hoje com 75 anos, Hawking só consegue executar discretos movimentos faciais. Mas são esses movimentos que ele usa para se comunicar.

Cabe a um software chamado ACAT (Assistive Context Aware Toolkit) interpretar esses movimentos. Quando algum recurso a ser usado é destacado na tela do computador, Hawking só precisa mexer o rosto para acioná-lo. Sensores colocados em seus óculos detectam a ação e enviam a instrução ao ACAT:

O ACAT teve que ser ajustado às necessidades de Stephen Hawking, quase como se fosse um software personalizado. Mas isso não quer dizer que outras pessoas não podem usá-lo: o projeto todo é open source.

Há muitos casos em que a pessoa consegue movimentar apenas os olhos e, aí, esse passa a ser o seu único canal de comunicação. Uma piscada para “sim” e duas para “não” costuma ser a abordagem mais usada.

Dá até para a pessoa formar palavras, piscando quando um auxiliar fala ou aponta para uma letra em um quadro, por exemplo — esse modo de comunicação pode ser visto no filme O Escafandro e a Borboleta, que conta a história de Jean-Dominique Bauby, um renomado jornalista francês que sofreu um AVC aos 43 anos de idade (yep, tem na Netflix).

Só que esse método é frequentemente cansativo e lento. A boa notícia é que tecnologias de rastreamento ocular (eye tracking) estão há algum tempo ajudando a combater essas limitações. A Tobii é uma das empresas mais renomadas do segmento, oferecendo soluções como a linha Dynavox. Com ela, é possível escrever mensagens e controlar outras funções do computador com o olhar:

O rastreamento ocular não funciona para todos os pacientes. Alguns deles ficam muito cansados usando os olhos para se comunicar, mesmo com o mais sofisticado dos equipamentos. Outros simplesmente não conseguem se adaptar a uma tecnologia desse tipo — às vezes, até a movimentação dos olhos acaba sendo comprometida.

Essa é uma das razões pelas quais a ciência vem tentando “ler” mentes. A ideia é que a pessoa possa não só se comunicar, mas dar comandos a um computador ou mesmo controlar uma máquina — como uma cadeira de rodas motorizada ou um exoesqueleto robótico — só pensando na ação.

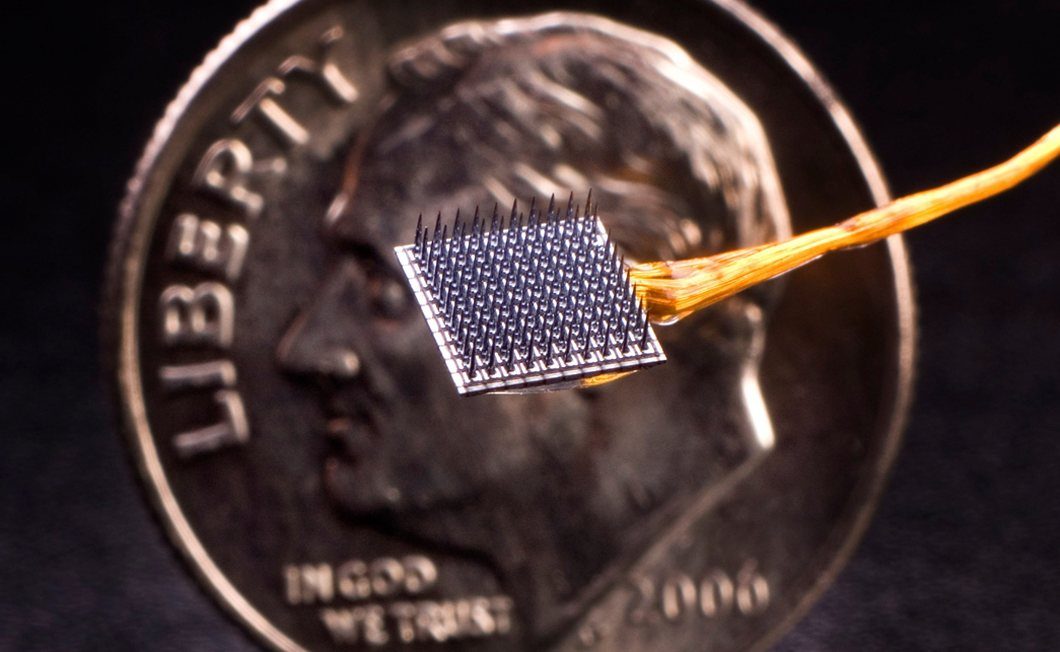

Há várias pesquisas voltadas a esse fim. Uma delas, conduzida por cientistas da Universidade Brown, nos Estados Unidos, consiste em um implante cerebral menor que uma moeda que detecta impulsos elétricos gerados pelo cérebro e envia essas informações para um computador. Na sequência, um algoritmo interpreta esses sinais e os converte na ação desejada.

Para cada tipo de atividade, o cérebro gera padrões distintos de impulsos. Se esses padrões forem corretamente identificados, o computador pode, portanto, executar a ação desejada.

Nos testes, os participantes conseguiram usar um cursor para alternar entre imagens exibidas em uma tela simplesmente imaginando que o seu dedo estava arrastando as fotos. Graças às técnicas empregadas para eliminar ruídos na detecção de sinais e ao aperfeiçoamento do algoritmo, essa ação passou a ser realizada com cada vez mais fluidez.

A expectativa é que esses ajustes permitam que, em um futuro não muito distante, esses participantes possam se imaginar digitando e, assim, escrever tão bem quanto uma pessoa que sabe usar bem o teclado.

Implantes cerebrais podem funcionar bem porque eles detectam sinais “direto na fonte”. Porém, esse tipo de dispositivo tem lá seus riscos: mesmo que o procedimento cirúrgico para a sua implantação seja executado seguindo todos os cuidados, a pessoa pode acabar tendo uma complicação por conta de uma infecção hospitalar, por exemplo.

Uma alternativa que vem sendo considerada por várias instituições é o eletroencefalograma, técnica usada há anos pela medicina para monitorar a atividade elétrica do cérebro.

A Emotiv é uma das empresas que apostam na ideia: entre os produtos da companhia está o Epoc, uma espécie de headset que usa eletroencefalografia para detectar padrões de atividade cerebral que correspondem a determinadas ações.

Por meio de um dongle USB, um computador recebe comandos “pensados”. Com isso, a pessoa pode escrever mensagens, reproduzir um vídeo, abrir o navegador, entre outras atividades. O Epoc está no mercado há alguns anos e vem sendo usado para diversas aplicações, incluindo realidade virtual e, claro, comunicação para pessoas com paralisia. A versão mais atual custa cerca de US$ 800.

Mas a eletroencefalografia não é a solução definitiva. Se a pessoa tem dificuldades para movimentar os olhos, ela não conseguirá visualizar informações na tela do computador para dar comandos, por exemplo. Para os casos mais graves, uma pesquisa desenvolvida na Suíça dá grandes esperanças.

A equipe do neurocientista Niels Birbaumer desenvolveu um sistema que não só detecta as ondas cerebrais por meio de eletroencefalografia como analisa o fluxo sanguíneo para “ler” a mente da pessoa. Acontece que a atividade cerebral muda os níveis de oxigênio, fazendo a cor do sangue sofrer discretas variações em sua coloração.

Birbaumer elaborou um questionário com dezenas de perguntas para treinar o algoritmo da pesquisa na identificação de padrões de atividade cerebral e fluxo sanguíneo que correspondem a afirmações ou negações.

Quando há síndrome do encarceramento, a comunicação baseada em “sim” e “não” passa a ter bastante valor para o paciente, para a família (que consegue fazê-lo participar de decisões) e para os médicos (que podem saber se a pessoa está com dor ou algum incômodo).

Considerando o poder computacional que temos hoje, podemos apostar que essas pesquisas evoluirão o bastante para permitir que frases inteiras sejam formuladas apenas com a “leitura” da mente. Complementando a ideia com tecnologias como o Adobe Project Voco, poderemos ter até computadores que falam pela pessoa usando a voz sintetizada dela.

E se é para ir longe, dá até para imaginar essas técnicas ajudando os médicos a compreenderem com mais precisão o que acontece no cérebro de uma pessoa em coma.