Apple poderia “ter sido mais clara” sobre análise de fotos, diz executivo

Craig Federighi garante que o novo sistema de análise de fotos do iCloud é auditável e monitora apenas materiais de abuso infantil

Craig Federighi garante que o novo sistema de análise de fotos do iCloud é auditável e monitora apenas materiais de abuso infantil

Desde que lançou seu novo sistema de análise de fotos do iCloud, a Apple tem sido alvo de críticas relacionadas à privacidade. Para alguns usuários, a empresa poderia usar o recurso para monitorar não só materiais de pornografia infantil, como também qualquer outro tipo de conteúdo. Um dos executivos da empresa, Craig Federighi admitiu que houve confusão ao explicar como a ferramenta funciona e que a maçã poderia ter sido mais clara.

“Está bem claro que muitas mensagens ficaram confusas, e o funcionamento do sistema ficou mal entendido”, disse Federighi, vice-presidente sênior de engenharia de software da Apple. “Gostaríamos que isso tivesse ficado um pouco mais claro para todos, porque nos sentimos felizes e fortes em relação ao que estamos fazendo”, concluiu.

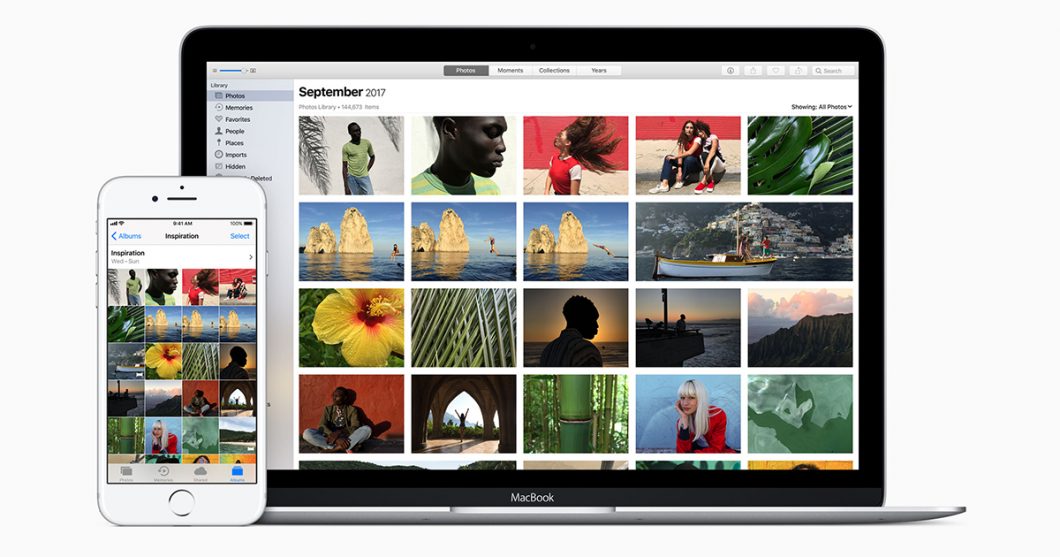

Na semana passada, a Apple apresentou dois novos recursos de segurança para o iCloud: o primeiro visa identificar fotos com materiais de pornografia infantil salvas na nuvem; e o segundo permite aos pais monitorarem as imagens recebidas e enviadas pelos filhos em mensagens de texto pelo iMessage.

Em entrevista ao Wall Street Journal, o executivo garantiu que ambos os sistemas são totalmente auditáveis e não prejudicam a privacidade dos usuários. Segundo o vice-presidente, devido à auditabilidade das ferramentas, os pesquisadores da Apple podem saber se a empresa está usando a tecnologia de forma errada.

No caso da análise de fotos do iCloud, Federighi explicou que o sistema vai identificar apenas as imagens existentes no banco de dados de “Material de Abuso Infantil”. Ele ainda disse que o recurso só irá enviar um alerta se houver mais de 30 fotos suspeitas salvas na nuvem.

O executivo também negou o boato que dizia que a maçã seria capaz de analisar outros tipos de conteúdo, como material político. De acordo com Federighi, as imagens presentes no banco de dados de Material de Abuso Infantil são relacionadas apenas a pornografia infantil e são fornecidas por agências especializadas em segurança de crianças.

Provavelmente, a explicação de Federighi ainda não deve ser suficiente para acabar com todas as suspeitas de que a Apple estaria espionando todas as fotos dos usuários. Esse debate, porém, faz a gente refletir: será que segurança e privacidade não podem andar juntas?

Você, leitor, acha que seria possível para a Apple criar um ambiente mais seguro para crianças, sem monitorar possíveis materiais de pornografia infantil no iCloud? Deixa a sua opinião sobre o assunto na Comunidade do Tecnoblog.