A série Silicon Valley, da HBO, é conhecida por refletir com precisão os bastidores do mundo da tecnologia, com grandes empresas tentando passar a perna em concorrentes menores, e ideias absurdas recebendo milhões de dólares em financiamento. Desta vez, no entanto, a vida imitou a arte.

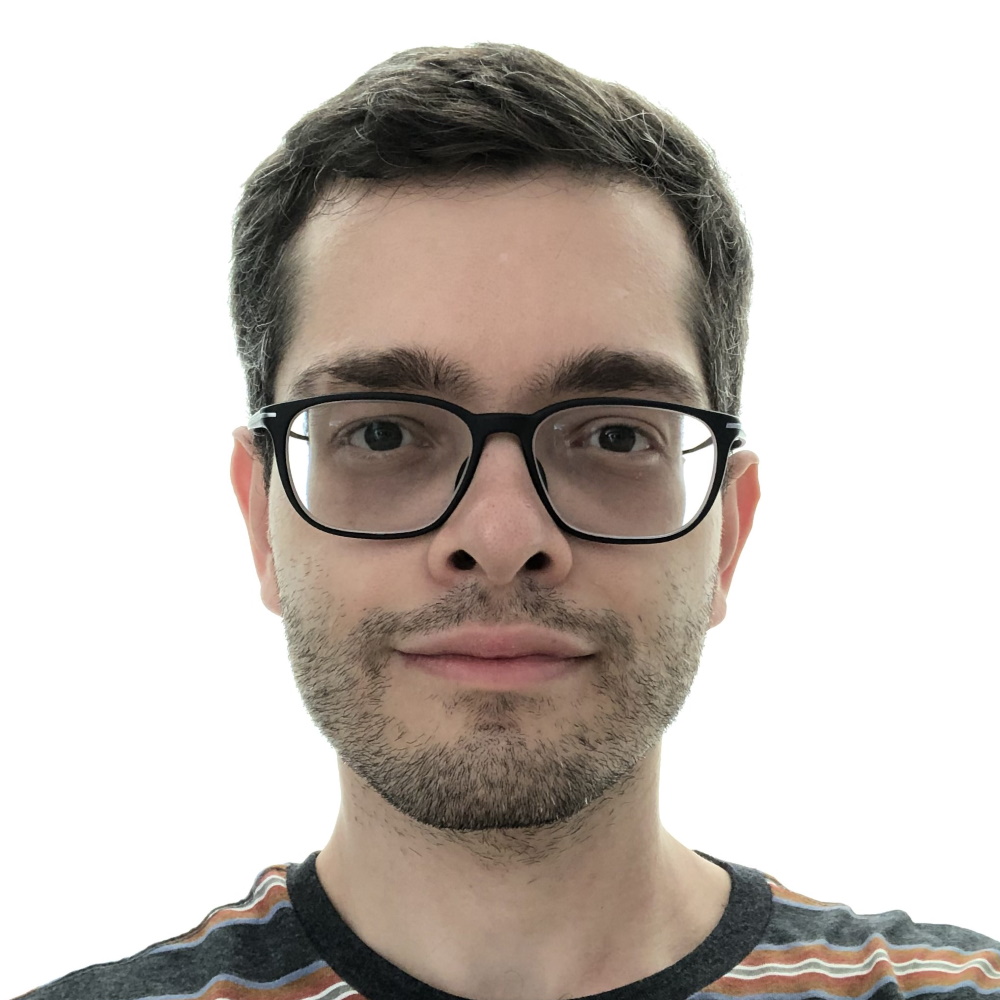

No episódio mais recente da série, Erlich e Jian-Yang descobrem que seu app funciona bem para identificar comida, desde que ela seja um cachorro-quente. Assim, eles resolvem lançar o “Not Hotdog”:

Um dos consultores técnicos da HBO realmente criou o app e o lançou para iOS; fãs da série, por sua vez, criaram versões não-oficiais para Android.

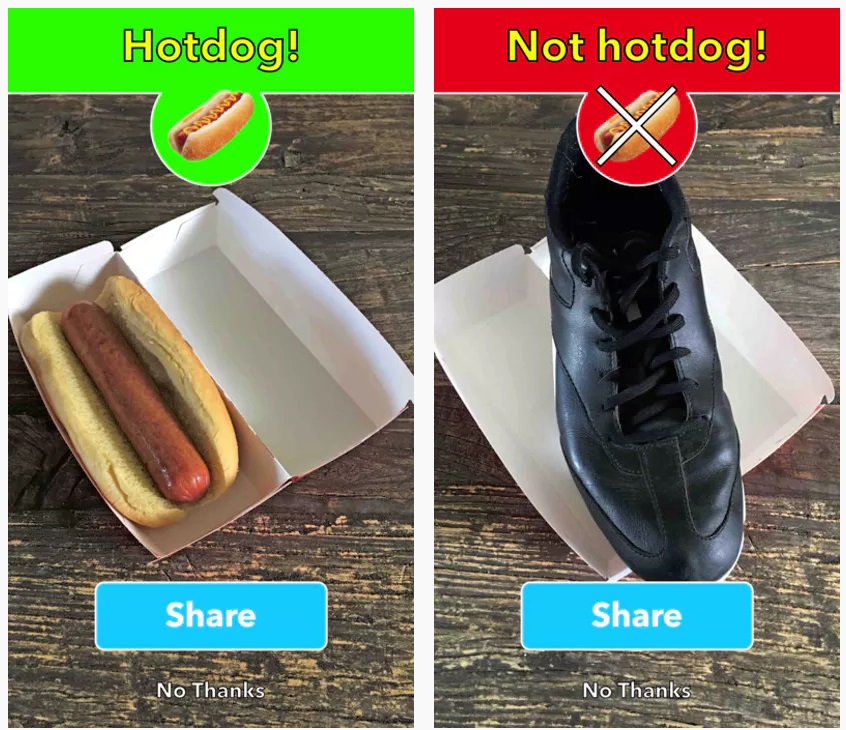

Coincidentemente, na mesma semana, o Pinterest lançou um recurso para identificar comida usando o smartphone. Você aponta a câmera para um ovo, um morango ou um cachorro-quente, e o app identifica o alimento e sugere receitas.

Isso faz parte do Pinterest Lens, que identifica objetos para sugerir uma busca relevante. Por exemplo, se você apontar a câmera para seus tênis vermelhos, o app vai trazer fotos de outros calçados da mesma cor. O recurso está disponível apenas nos EUA.

Para mim, a utilidade disso é duvidosa — você poderia digitar “tênis vermelho” ou “hot dog” na busca, em vez de usar a câmera — mas a empresa levou na brincadeira a coincidência com Silicon Valley.

.@SiliconHBO! Tell Jian Yang I think I may have found the best of both worlds? pic.twitter.com/Y6WZp9dmUY

— Pinterest Lens (@PinterestLens) May 16, 2017

Outras empresas estão trabalhando em recursos semelhantes. O assistente Samsung Bixby, por exemplo, também identifica objetos e sugere imagens com base nisso. Além disso, ele oferece sugestões de locais perto de um ponto turístico, traduz texto em outros idiomas, e até encontra mais informações sobre um vinho ao visualizar o rótulo da garrafa.

Por sua vez, o Google Lens — anunciado na conferência I/O — vai trazer mais informações sobre o que a câmera do smartphone estiver vendo:

With Google Lens, your smartphone camera won’t just see what you see, but will also understand what you see to help you take action. #io17 pic.twitter.com/viOmWFjqk1

— Google (@Google) May 17, 2017

Aponte-a para um restaurante e você verá avaliações de quem já o experimentou; aponte-a para o cartaz de um show, e surgirá a opção de conhecer o artista e comprar ingressos; aponte-a para as credenciais do roteador e seu dispositivo Android se conecta ao Wi-Fi. Ele fará parte do Google Assistant nos próximos meses.

Enquanto isso, vá se acostumando com a ideia de que mais empresas vão usar visão computacional, mesmo quando isso não for imediatamente útil. E assista Silicon Valley.

Com informações: The Verge.

![Como usar o Pinterest [Guia Completo]](https://files.tecnoblog.net/wp-content/uploads/2018/11/pinterest-340x191.png)