Sabe aqueles filmes em que o policial amplia a foto de um suspeito no computador para deixá-la mais nítida? Chega a ser divertido. E em cada ampliação, o computador ainda faz um “bip”. Mas esse truque tão comum na ficção está prestes a virar realidade: o Google está trabalhando em um algoritmo que cria imagens detalhadas a partir de originais com resolução muito, mas muito baixa.

Trata-se de mais uma obra do Google Brain, uma das divisões da companhia que cuidam de projetos de inteligência artificial, segundo o Ars Technica. O que os pesquisadores fizeram, basicamente, foi unir dois algoritmos de redes neurais.

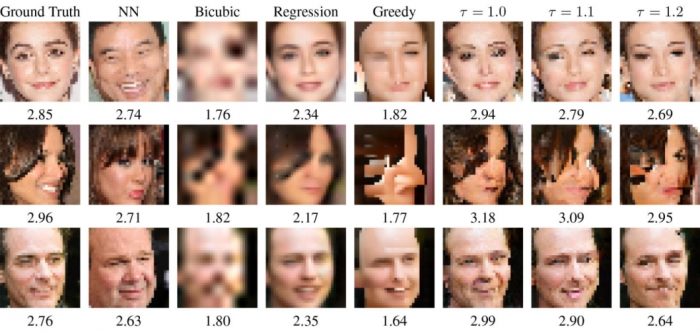

O primeiro algoritmo é uma “rede de condicionamento”, que compara uma imagem com poucos pixels com outras de maior resolução para encontrar um padrão, ou seja, características que a tornem semelhantes.

Tome, como exemplo, uma foto de 8×8 pixels. O algoritmo pega imagens com maior resolução e as redimensiona para também deixá-las com 8×8 pixels. Depois, essas imagens são comparadas com a foto que já tinha essa resolução. Dessa forma, é possível encontrar correspondências, ou seja, imagens com características similares à foto original.

Já o segundo algoritmo, uma “rede prévia”, tem como base uma implementação do software de geração de imagens PixelCNN. Aqui, a foto original é escalonada e comparada com imagens com resolução maior até que a sua categoria seja identificada. Quando essa etapa é concluída, o algoritmo adiciona detalhes na imagem, tendo como referência outras imagens da mesma categoria.

Por exemplo, um pixel avermelhado é identificado na parte inferior da foto original. Nas outras imagens, essa mesma posição se relaciona com um grupo de pixels com cor semelhante que, por sua vez, corresponde a lábios. A imagem original então é ampliada e preenchida com pixels parecidos que extraídos de outras fotos.

É um exemplo bem simples, mas que mostra como a imagem é construída. O resultado final não é, de fato, uma imagem ampliada, mas uma “suposição” de como aquela foto seria se tivesse mais pixels.

Para o Google, uma tecnologia como essa pode ajudar a melhorar a qualidade das imagens armazenadas no Google Fotos, por exemplo. Quando estiver mais evoluída, talvez a tecnologia até possa ajudar a polícia a identificar suspeitos em uma imagem de baixa resolução. Se isso acontecer, só vai ficar faltando o “bip” do computador para a realidade suplantar de vez a ficção.

![Como encontrar imagens gratuitas na Pesquisa Google [Free-to-Use]](https://files.tecnoblog.net/wp-content/uploads/2020/11/como-encontrar-imagens-gratuitas-google2-340x191.jpg)