Conteúdo feito pela OpenAI é bem-vindo no BuzzFeed e Medium

Apesar de polêmicas com IAs gerando textos com erros e plágios, BuzzFeed e Medium abrirão as portas para mecanismos como o ChatGPT

Apesar de polêmicas com IAs gerando textos com erros e plágios, BuzzFeed e Medium abrirão as portas para mecanismos como o ChatGPT

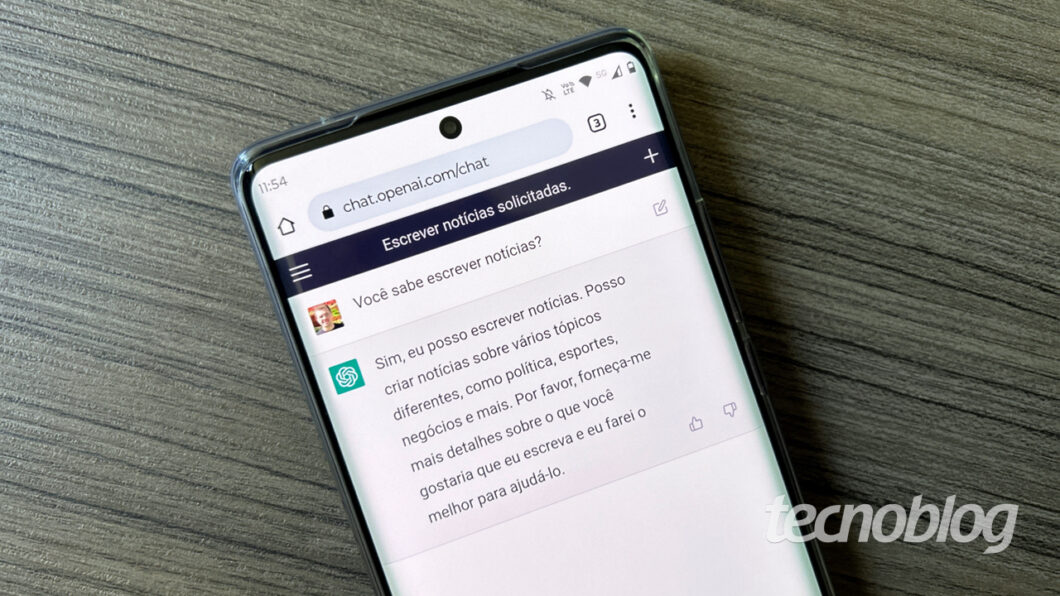

A CNET usou uma inteligência artificial (IA) para gerar notícias sobre investimentos, mas muitas delas tinham informações erradas. O assunto causou polêmica, mas não assustou outros serviços. O BuzzFeed confirmou que usará ferramentas do tipo em seu conteúdo. E o Medium informou que textos escritos por IAs são aceitos em sua plataforma.

No caso do BuzzFeed, não é algo para um futuro distante. Jonah Peretti, CEO da companhia, declarou ao The Verge que o site receberá “conteúdo inspirado em IA” em 2023. Essa experiência, por assim dizer, deve começar em fevereiro.

Mas parece que, no BuzzFeed, o uso de inteligência artificial na produção de conteúdo será mais cuidadoso. Peretti explica que o veículo usará ferramentas fornecidas pela OpenAI (a criadora do ChatGPT), mas para melhorar quizzes (questionários), gerar informação para brainstorming (discussão de ideias) e personalizar conteúdo para os usuários.

Gerar notícias? Matt Mittenthal, vice-presidente de comunicações do BuzzFeed, disse que não. Talvez esse cuidado seja inspirado no caso da CNET. O veículo teve que se retratar por publicar textos sobre investimentos que, gerados por IA, traziam informações inconsistentes.

É aí que mora o perigo. De modo geral, ferramentas como o ChatGPT são muito boas em gerar conteúdo convincente, mas não necessariamente correto. As implicações podem ser desastrosas. No caso da CNET, imagine o transtorno que um leitor do veículo teria ao tomar uma decisão financeira equivocada por causa de uma notícia incorreta.

Apesar dos riscos, ferramentas de IA atraem a atenção das empresas de mídia. Teoricamente, elas são mais baratas do que o trabalho feito por humanos. Para uma empresa afetada por queda na receita com publicidade, como é o caso do BuzzFeed, mecanismos como o ChatGPT são ainda mais tentadores.

Não que ferramentas para geração automática de conteúdo já não existam. Mas, normalmente, elas são empregadas em textos “robotizados”, para divulgar resultados financeiros, por exemplo.

Com a inteligência artificial no nível em que está, a abrangência de temas que podem ser abordados pelo ChatGPT e afins aumenta exponencialmente, a ponto de termos um novo “mercado” de conteúdo.

No Medium, o conteúdo é publicado pelos usuários. Não demorou para textos gerados por IA baterem à porta do serviço. É por isso que a empresa já elaborou uma política para textos oriundos de ferramentas como o ChatGPT.

O Medium não proíbe conteúdo gerado por IA. No entanto, a plataforma exige que esse tipo de texto seja identificado como tal. Se o serviço descobrir um conteúdo que aparenta ter sido gerado por IA, mas não foi devidamente rotulado, ele será mantido, mas não entrará nos mecanismos de recomendação e divulgação.

Mas isso não quer dizer que o Medium não terá desafios para lidar. Já sabemos que, além de gerar informações incorretas, ferramentas de IA podem até plagiar conteúdo. Em situações extremas, isso poderá trazer problemas legais para a empresa.

Essa pode ser uma das razões para Scott Lamb, vice-presidente de conteúdo do Medium, ter declarado que a recente política da plataforma para conteúdo de IA é apenas uma “abordagem inicial” sobre o assunto.