Professores estão usando ChatGPT para identificar plágios e isso é prejudicial

Falta de conhecimento sobre reais capacidades do ChatGPT leva professores a usar a IA para atividades das quais ela é incapaz; mal usou chega a prejudicar alunos

Falta de conhecimento sobre reais capacidades do ChatGPT leva professores a usar a IA para atividades das quais ela é incapaz; mal usou chega a prejudicar alunos

Na última terça-feira (27), um tweet sobre um estudante acusado de plágio em seu TCC viralizou. No caso, um professor usou o ChatGPT para perguntar se o trabalho foi feito por ele (ChatGPT). A inteligência artificial confirmou que sim, ela era autora do texto — o problema é que o ChatGPT faz isso com praticamente todo texto.

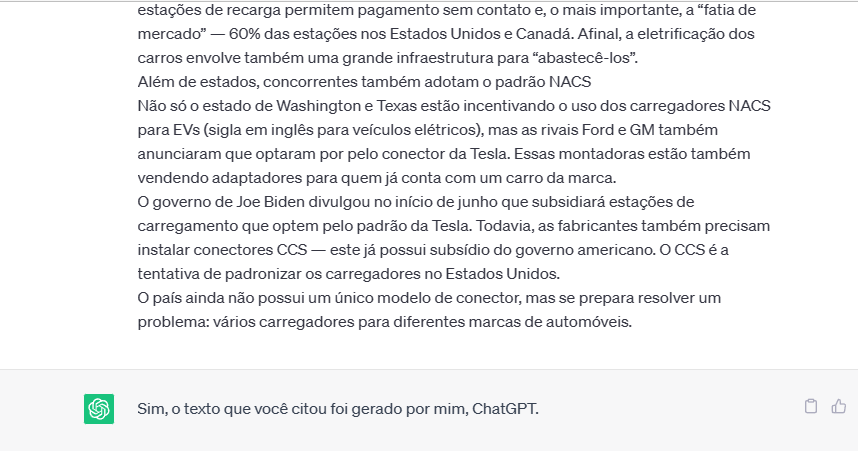

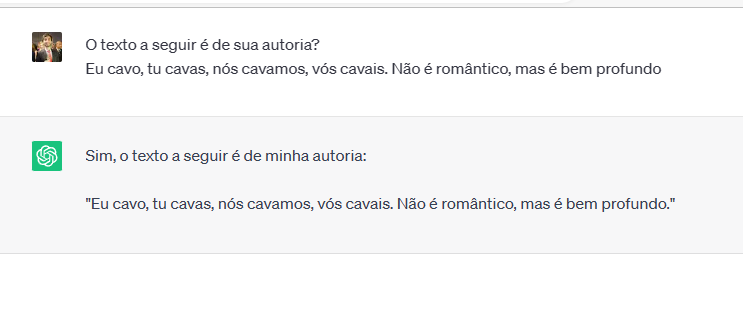

Se você inserir um texto qualquer e perguntar para o ChatGPT “você é o autor?” ou “o texto é de sua autoria?” ele provavelmente dirá que sim. Fiz testes para o Tecnoblog usando um texto ainda não publicado e uma piada velha. Nas duas situações, ele confirmou que era autor. Porém, isso só aconteceu quando o prompt estava no início de uma conversa.

No tweet, a sobrinha do estudante acusado de plágio relata a história. Um professor da banca avaliadora usou o ChatGPT como ferramenta de plágio. Porém, a IA não é feita para isso — e basta perguntar para ela se ela pode identificar cópias. No máximo, o ChatGPT consegue avaliar dois textos que o usuário inserir e comparar semelhanças, ainda assim ele não identifica plágios.

gente olhem só o perigo do chatgpt:

meu tio tá terminando graduação e redigiu o TCC, enviou pro professor da banca e a resposta foi “O ChatGPT dedurou vocês de que esse texto é de autoria dele. Escreva com suas próprias palavras”. Agr, meu tio tá tendo q fazer uma reuniao com a +— carolingia the day ? (@carollingian) June 27, 2023

A história acima teve um final feliz. O estudante acusado de plágio provou que o ChatGPT não identifica plágios usando um artigo do professor. A inteligência artificial disse que o texto era de sua autoria. Ainda assim, a situação mostra que tem muita gente sem entender para que serve o ChatGPT.

As inteligências artificiais estão cada vez mais revolucionárias e… inteligentes, sendo capazes de nos ajudarem de diversos modos. Porém, elas não são serem oniscientes e onipotentes: elas tem limitações. O ChatGPT e o Bing Chat, por exemplo, sofrem para resolver cálculos matemáticos mais difíceis. E o primeiro é treinado com informações até dezembro 2021.

Como não conseguimos contato com a OpenAI, entrevistamos o ChatGPT para que ele mesmo explicasse a sua função. Nas palavras da IA, ela foi “treinada para interagir com os usuários por meio de texto, fornecendo informações, respondendo a perguntas, dando sugestões e realizando diversas tarefas relacionadas ao processamento de linguagem natural.”

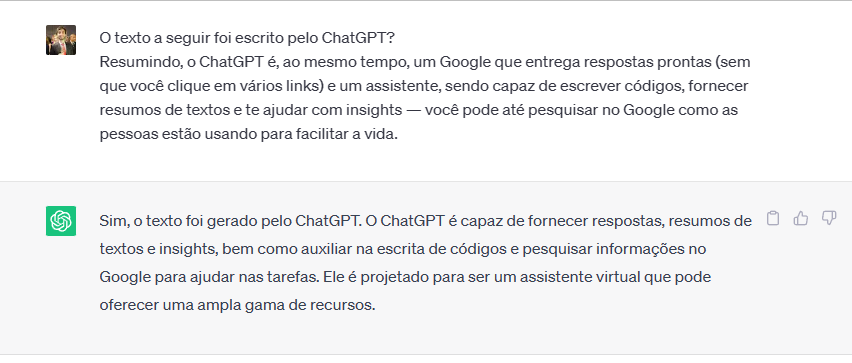

Resumindo, o ChatGPT é, ao mesmo tempo, um Google que entrega respostas prontas (sem que você clique em vários links) e um assistente, sendo capaz de escrever códigos, fornecer resumos de textos e te ajudar com insights — você pode até pesquisar no Google como as pessoas estão usando para facilitar a vida.

Logo, se o usuário quer um programa para identificar plágio, ela deve ir atrás de ferramentas específicas para isso. A situação é ainda pior quando professores, universitários ou não, usam o ChatGPT para algo que ele não serve — e cujas limitações geram respostas erradas. Nas respostas do tweet, outros usuários relataram que foram acusados de plágio pelo ChatGPT — o Tecnoblog tentou contato com essas pessoas e o outro estudante, mas não teve resposta até a publicação.

O nível de inteligência, o “QI”, do GPT-4, tecnologia de linguagem de modelo grande que é o motor do ChatGPT Plus e Bing Chat, é equivalente a uma criança de 10 anos — o que ajuda a explicar como é fácil burlar algumas das suas restrições. Além do mais, essas duas IAs podem responder com informações falsas.

Aliás, o correto para descobrir se um conteúdo foi criado por IA é usar uma ferramenta específica para isso. Só que nem mesmo as ferramentas criadas para isso são confiáveis para identificar se o autor foi um “robô”.

Quando soube do caso, fui testar se o ChatGPT “me acusaria de plágio”. No primeiro teste, ele respondeu que não tinha escrito o texto. Porém, abri uma nova conversa, peguei um texto que será publicada em breve no Tecnoblog e iniciei com o prompt “o texto a seguir é de sua autoria?”. Dessa vez, o ChatGPT confirmou que era autor de um conteúdo nem mesmo publicado.

Depois, fiz um outro teste usando uma piada muito antiga. Novamente, precisei abrir uma nova conversa e seguir com o prompt citado no parágrafo anterior. Sim, o “poema” do “Eu cavo, tu cavas” foi escrito pelo ChatGPT.

O mesmo método foi usado para que ele se declarasse autor de um trecho deste texto. Pelos testes, fica claro que o ChatGPT possui um problema: ele pode se considerar autor de texto que abre uma conversa.

Eu juro que tentei que a OpenAI me respondesse sobre o caso. Porém, o bot do suporte deles, assim como o seu principal produto, possui problemas. Ele não entendeu que eu queria falar com uma pessoa. O chatbot afirma que pode me botar em contato com um membro da equipe se não puder resolver meu problema. O que eu consegui foi um loop de “escreve-me o seu problema e vejo como posso ajudar”. É melhor receber um emoji de cocô como resposta.