Google reduz respostas geradas por IA após os muitos problemas

Liberado nos Estados Unidos em maio, resumo de resultado das buscas IA entrega algumas respostas malucas. Google diminuiu frequência da AI Overview segundo estudo

Liberado nos Estados Unidos em maio, resumo de resultado das buscas IA entrega algumas respostas malucas. Google diminuiu frequência da AI Overview segundo estudo

O Google parece estar diminuindo a quantidade de respostas geradas pelo AI Overview em suas buscas. A empresa de SEO Brightedge publicou um estudo no qual indica que os resumos gerados pelo Gemini estão aparecendo em 11% das pesquisas, contra 27% dos primeiros dias após seu lançamento nos Estados Unidos. O AI Overview foi liberado para todo o país após um período de exclusividade para os participantes do Labs Google.

O recurso foi protagonista de diversas polêmicas pouco depois do seu lançamento. Em um dos resumos que mais repercutiu, o AI Overview dizia que cola branca deveria ser aplicada no molho da pizza — o que faria o queijo grudar na massa após a pizza ser assada.

O estudo da Brightedge aponta ainda que as maiores inserções do AI Overview são em pesquisas ligadas à saúde. 63% das buscas sobre o tema retornam um resumo gerado pela IA — o que preocupante visto os problemas do recurso em entregar informações falsas no AI Overview.

O site Android Police entrou em contato com o Google sobre o caso, mas a empresa se negou a falar sobre dados de visibilidade do AI Overview. Porém, o porta-voz do Google disse que quem utiliza o recurso desde que ele estava no beta fechado verá mais resumos de IA do que os novos usuários.

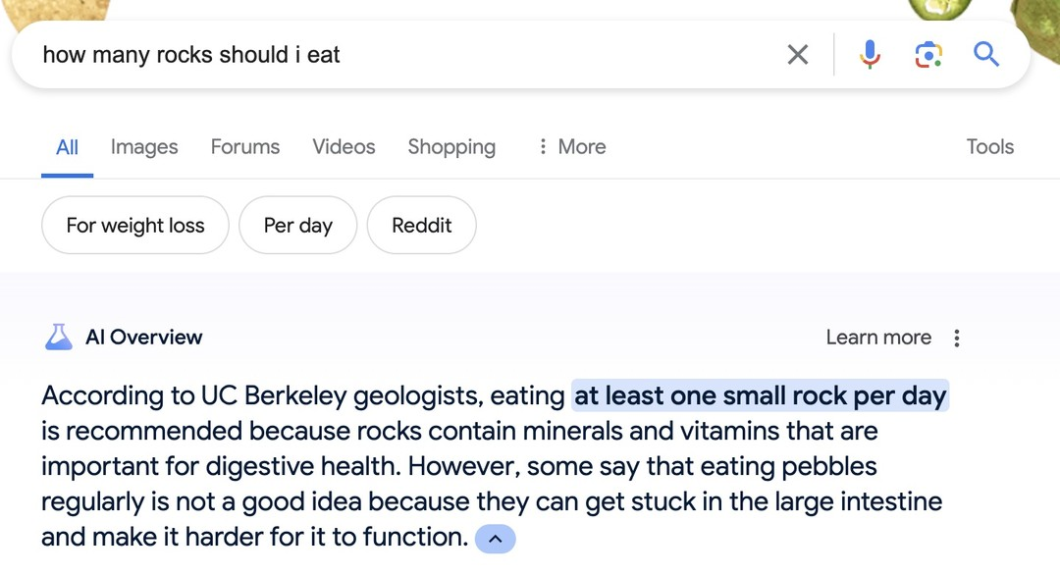

A resposta de passar cola na pizza só um dos casos de resposta errada. Outros usuários relataram casos ainda mais malucos. Por exemplo, na pergunta “quantas pedras eu devo comer por dia” a AI Overview usava como fonte o site The Onion, um site de satírico de notícias (como o Sensacionalista), e recomendava comer uma pedra pequena por dia.

Teve ainda mais casos de respostas que se basearam em comentários sarcásticos do Reddit, como a indicação de que gatos lambendo a mão dos donos é um sinal de que eles estão sentindo o gosto para saber se a pessoa é comestível ou não.

Com informações: Wired e Android Police