Google I/O: Android terá IA como peça-chave e Gemini Nano multimodal

Em evento totalmente focado no Gemini, Google abre curto espaço para mostrar como a IA será cada vez mais integrada ao Android

Em evento totalmente focado no Gemini, Google abre curto espaço para mostrar como a IA será cada vez mais integrada ao Android

O presidente da divisão de ecossistema Android, Sameer Samat, apresentou no Google I/O 2024 os planos para melhorar a experiência do usuário do sistema. O executivo destacou um novo slogan para o Android: “IA em seu núcleo” (“AI at the core” na tradução direta). Em outras palavras, a inteligência artificial será a essência do sistema operacional e o Gemini Nano multimodal chegará para os smartphones.

Um dos recursos mostrados já era conhecido: a ferramenta Circular para Pesquisar, que foi apresentada originalmente junto com o Galaxy S24. A melhoria apresentada por Samaat foi o uso da ferramenta para a resolução de problemas matemáticos — algo bem parecido com o que a OpenAI apresentou na última segunda-feira.

O funcionamento é bem direto: você circula, a IA identificará a equação/fórmula/problema e apresentará uma solução. Essa novidade, ao contrário daquelas citadas posteriormente, já está liberada para os usuários de smartphones compatíveis.

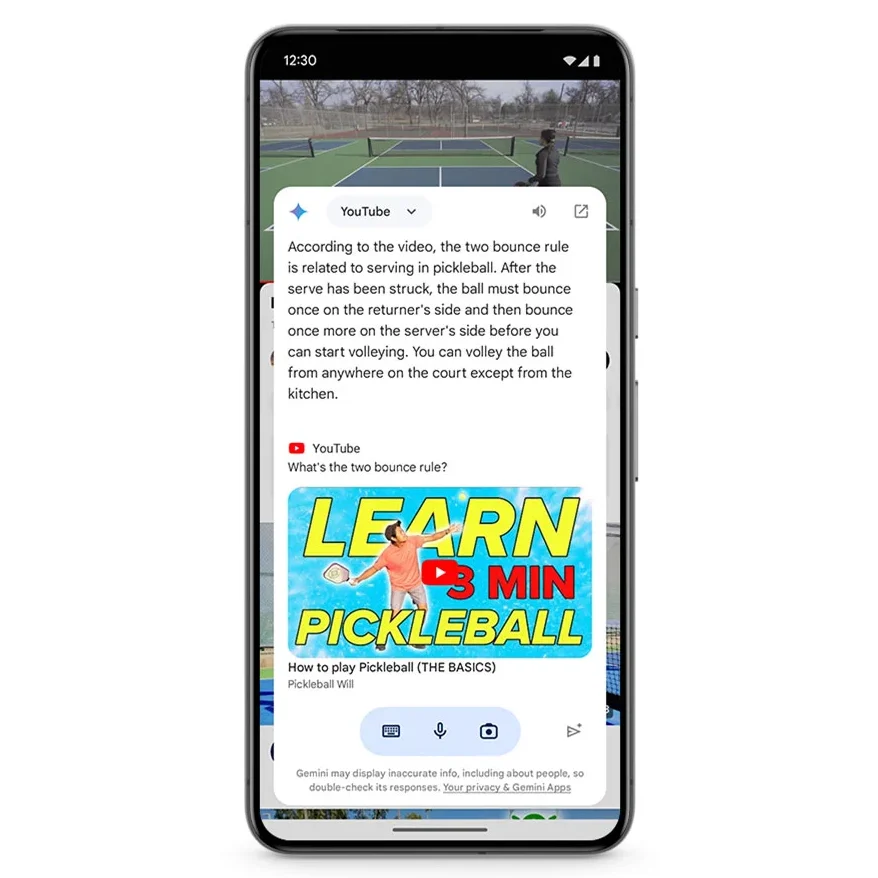

Dave Burke, vice-presidente de engenharia, apresentou outras melhorias do Gemini para Android. Ele explicou que o app da IA poderá ser ativado sobre outros aplicativos, o que permitirá que o Gemini entenda o contexto da sua pergunta.

Por exemplo, você pode estar com uma tela aberta numa receita. Ao abrir o app da IA e fazer um questionamento, o Gemini avaliará o que está escrito e qual aplicativo você está usando.

Na apresentação, Burke também explicou que funções multimodais chegarão ao Gemini Nano, LLM que roda nativamente em celulares. Essa tecnologia permite que a IA seja usada para tarefas visuais e de áudio.

Isso pode ser útil para usuários com deficiência visual, já que a câmera do smartphone poderá ser usada para explicar o que há nos arredores, localização. As funções de áudio também auxiliam na comunicação, ouvindo o ambiente. Essa tecnologia chegará primeiro para smartphones Pixel em um momento posterior

Burke mostrou ainda uma funcionalidade do Gemini para identificar possíveis golpes em ligações. O exemplo usado na apresentação era mais “óbvio”, com o golpista dizendo que, para proteger a conta dos acessos indevidos, era necessário transferir o dinheiro para uma conta mais segura. Será interessante ver o Gemini atuando em casos mais sofisticados.