Google Play adota novas regras para combater deepfakes de nudez e violência

Aplicativos oferecidos na loja do Google não poderão usar IA para gerar conteúdo sexual, violento ou desonesto, nem anunciar recursos do tipo em propagandas

Aplicativos oferecidos na loja do Google não poderão usar IA para gerar conteúdo sexual, violento ou desonesto, nem anunciar recursos do tipo em propagandas

O Google atualizou as regras da Google Play, sua loja de aplicativos para Android, para coibir deepfakes envolvendo nudez e pornografia. Desenvolvedores que oferecem recursos de inteligência artificial generativa precisarão impedir a criação de conteúdo restrito, como sexual, violento ou desonesto, entre outros.

Além da proibição da IA generativa para conteúdo restrito, o Google vai exigir que as ferramentas ofereçam opções para denunciar conteúdo ofensivo. Segundo a empresa, os desenvolvedores terão que testar rigorosamente seus aplicativos para garantir o respeito à segurança e à privacidade dos usuários.

Os apps não poderão fazer propaganda dizendo ser capazes de criar imagens de nudez sem consentimento. Quem fizer isso poderá ser banido.

Recentemente, o site 404 Media revelou que aplicativos para geração de deepfakes estavam fazendo anúncios no Instagram usando nudez como um de seus atrativos. Um deles prometia “tirar a roupa de qualquer mulher de graça” e usava uma imagem da modelo Kim Kardashian. Apple e Google removeram estes apps de suas lojas.

As novas regras estão em uma atualização publicada na quinta-feira (6). Em maio, o Google passou a ocultar deepfakes pornográficos nos resultados da busca.

Deepfake é o nome dado a uma imagem ou vídeo realístico gerado por IA, mas que usa o rosto de uma pessoa real. A prática já existe há alguns anos, com vários casos nocivos. O youtuber Gesiel Taveira, por exemplo, denunciou que estavam usando um deepfake dele para divulgar promoções falsas e fraudulentas.

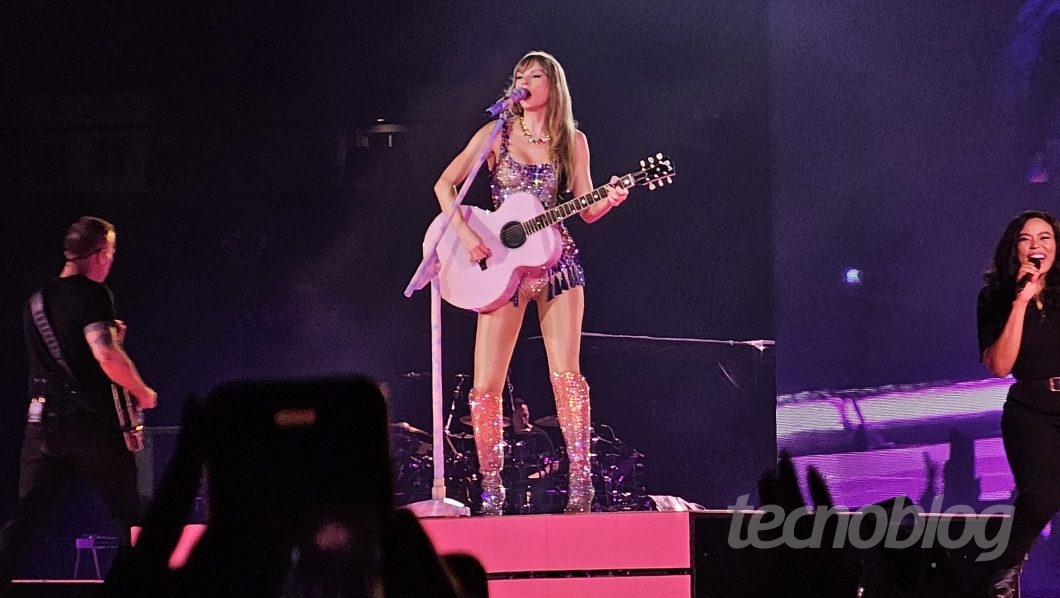

Em janeiro deste ano, imagens pornográficas geradas por IA da cantora Taylor Swift foram publicadas massivamente na rede social X (antigo Twitter).

A plataforma precisou bloquear buscas com o nome da artista para conter a disseminação do conteúdo até que as equipes da empresa conseguissem removê-lo por completo. A Microsoft também adicionou restrições à sua ferramenta Designer para evitar que ela gerasse este tipo de conteúdo.

No Brasil, a atriz Isis Valverde passou por situação parecida. Ela procurou a Delegacia de Repressão aos Crimes de Informática para denunciar o crime.

Os deepfakes não afetam apenas famosos. Adolescentes têm criado imagens pornográficas e racistas de colegas de escola e até de professores usando IA, como forma de bullying e assédio.

Um destes casos aconteceu no Colégio Santo Agostinho, no Rio de Janeiro (RJ). Pelo menos 20 meninas tiveram imagens alteradas. Os suspeitos são alunos do 7º ano ao 9º ano da escola.

Com informações: TechCrunch, Mashable

Leia | O que é deepfake? Conheça exemplos e entenda os riscos dessa tecnologia