OpenAI libera ferramenta de instruções predefinidas para respostas do ChatGPT

Funcionalidade está em beta no ChatGPT Plus e permite que usuários definam como a IA deve responder as suas perguntas; versão final deve ser liberada para todos em breve

Funcionalidade está em beta no ChatGPT Plus e permite que usuários definam como a IA deve responder as suas perguntas; versão final deve ser liberada para todos em breve

A OpenAI anunciou na última quinta-feira (20) a ferramenta de instruções padrões para o ChatGPT. Ainda em fase beta e disponível apenas para os assinantes do ChatGPT Plus, o recurso deve facilitar o uso da IA, permitindo que os usuários criem uma “estrutura” para que a inteligência artificial responda um comando de modo específico. A OpenAI espera lançar o recurso definitivamente e para todos os usuários nas próximas semanas.

O exemplo dado pela OpenAI e que também usaremos aqui é o seguinte: um professor da terceira série registrará na sua conta a sua profissão, permitindo que ele não repita que é um professor toda vez que enviar um prompt para o ChatGPT.

Além disso, o usuário pode definir como deseja receber a resposta. Por exemplo, o professor imaginário citado anteriormente pode preferir uma tabela com coluna de lado positivo e negativo de um determinado assunto que será apresentado em sala.

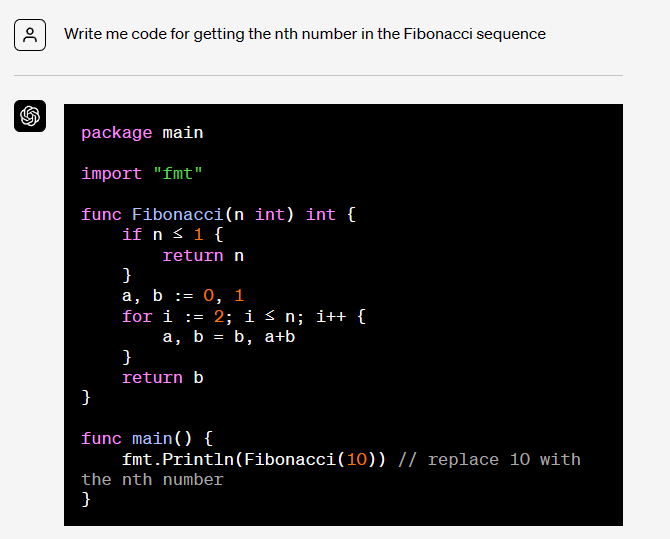

Em outra situação, a OpenAI mostra que um programador pode pedir que a resposta do ChatGPT seja direta, sem explicação sobre como funciona o código e que ele busque pela solução mais eficiente. E neste caso, o programador ainda pode adicionar com qual linguagem ele trabalha. Assim, não precisa escrever “escreva um código em Python” ou “escreva um código GoLang”.

Informar a sua profissão ou o tamanho da sua família e onde você mora (esse é um dos exemplos no site da OpenAI) é bem invasivo do ponto de vista de privacidade. Ciente disso, a OpenAI permite que o usuário desative o uso das informações das instruções padrões para melhorar o desempenho do ChatGPT.

A empresa afirma que os dados pessoais que facilitem a identificação de alguém são removidos quando usado para treinar a IA. Todavia, o problema é se acontecer um vazamento, como já sofreu a OpenAI duas vezes: uma por erro próprio e a outra na qual ela jogou a culpa nos usuários.

Com informações: OpenAI